Algorytmy social mediów da się poprawić, aby były mniej destrukcyjne społecznie. Musimy tylko wskazać do tego instytucje

W prestiżowym czasopiśmie naukowym Nature ukazał się niedawno raport zespołu międzynarodowych badaczy, którzy przeanalizowali wpływ algorytmu platformy X, dawniej Twitter, na poglądy polityczne użytkowników. Badanie objęło blisko pięć tysięcy osób w Stanach Zjednoczonych i miało charakter eksperymentalny. Badacze przeprowadzili eksperyment na 4 965 aktywnych użytkownikach platformy X w USA w latach 2023–2024, porównując wpływ algorytmicznego feedu rekomendacji z klasycznym, chronologicznym układem treści, i wykazali, że algorytm promował pewne rodzaje treści politycznych bardziej niż inne, przyczyniając się do zmian w zachowaniach informacyjnych użytkowników nawet po wyłączeniu algorytmu.

Według autorów publikacji algorytm systematycznie wzmacniał ekspozycję na treści o określonym profilu ideologicznym, w szczególności związane z przekazem konserwatywnym, oraz promował konta o charakterze aktywistycznym kosztem tradycyjnych źródeł informacyjnych.

To, co w badaniu szczególnie istotne, to trwałość efektu. Użytkownicy, którzy przez pewien czas korzystali z algorytmicznie kuratorowanego feedu, częściej zaczynali obserwować konta o wyraźnym profilu politycznym. Nawet po powrocie do trybu chronologicznego ich środowisko informacyjne pozostawało już zmienione, ponieważ sami zmodyfikowali sieć obserwowanych źródeł. Oznacza to, że wpływ algorytmu nie ogranicza się do chwilowej ekspozycji na konkretne treści, lecz może prowadzić do trwałej rekonfiguracji informacyjnej bańki użytkownika. Mechanizm działania takiej nowoczesnej socjotechniki jest subtelny i opiera się na optymalizacji uwagi. Algorytm rekomendacyjny analizuje historię kliknięć, czas zatrzymania na poście, reakcje, komentarze oraz sieć kontaktów. Na tej podstawie przewiduje, jakie treści z największym prawdopodobieństwem zwiększą zaangażowanie. W praktyce oznacza to preferowanie materiałów wywołujących silne emocje, kontrowersje i jednoznaczne stanowiska.

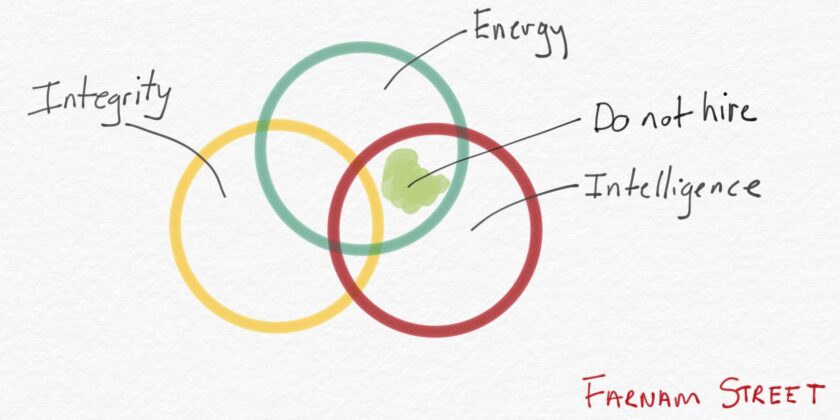

Treści umiarkowane, zniuansowane lub analityczne przegrywają w tej konkurencji, ponieważ generują mniejszą liczbę interakcji. W efekcie algorytm może premiować przekazy spolaryzowane, a z czasem wzmacniać podziały w społeczeństwie.

Badacze sugerują, że w skali całej populacji takie mechanizmy mogą mieć wymierny wpływ na procesy wyborcze. Jeśli miliony użytkowników są systematycznie eksponowane na określony typ narracji, a jednocześnie ograniczana jest widoczność innych perspektyw, może to przełożyć się na zmianę postaw i decyzji politycznych. W badaniu wskazano, że efekt ten nie musi być spektakularny w skali jednostki, ale nawet przesunięcie rzędu jednego lub dwóch punktów procentowych w preferencjach wyborczych może mieć znaczenie w wyrównanych wyborach. Wnioski z raportu Nature są dalekie od sensacyjnych oskarżeń, ale wyraźnie pokazują strukturalny problem. Platforma nie musi intencjonalnie promować konkretnej ideologii, aby w praktyce wzmacniać określony kierunek narracji. Wystarczy, że algorytm maksymalizuje wskaźniki zaangażowania, a dynamika emocjonalna dyskursu zrobi resztę.

To właśnie sprzężenie między ekonomią uwagi a polityką staje się kluczowym polem ryzyka.

Co można zrobić, aby ograniczyć negatywne skutki takiego modelu? Po pierwsze potrzebna jest większa przejrzystość algorytmów. Instytucje państwowe i regulatorzy powinni mieć dostęp do danych pozwalających ocenić, jakie treści są promowane i według jakich kryteriów. Niezależne audyty algorytmiczne mogłyby stać się standardem w przypadku platform o znaczeniu systemowym. Po drugie warto wprowadzać obowiązek oferowania realnej alternatywy w postaci domyślnego feedu chronologicznego lub trybu z ograniczoną personalizacją.

Kolejnym krokiem mogłoby być wzmocnienie wymogu różnorodności źródeł w systemach rekomendacji.

Algorytm mógłby być projektowany tak, aby w określonych proporcjach prezentować treści o odmiennych perspektywach, zamiast wyłącznie maksymalizować prawdopodobieństwo kliknięcia. To nie oznacza ingerencji w wolność słowa, lecz zmianę parametrów optymalizacyjnych z czysto komercyjnych na bardziej zrównoważone społecznie.